海螺AI算是AI视频界的当红炸子鸡了,不知道你用着感受怎么样?

生活、工作中,我们很多人都有视频创作的需要,对于非专业人士,AI视频工具能够快速帮助我们实现创意,方便实用。

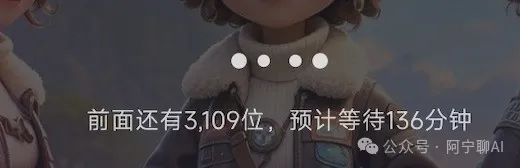

然而当你默念着灵机一动的创意,写出了要求满满的提示词,在海螺AI点击提交的时候,你可能要等2个小时才能看到成品。

没错像这样。

好不容易生成出来,它可能还会有以下问题:

- 主体和场景融合得不够自然

- 人物的表情也有些生硬

- 和你脑海中的预期效果相差甚远

于是又会产生如下问题:

- 想要批量生成一些视频素材,为项目提供更多选择,海螺 AI 却办不到

- 一个一个地生成视频,费用也在不断累积,负担不小

门槛太高啊,又要提示词准确,耗时又长,还可能反工,咋整?

你可以试试Vidu。

它是一款由北京生数科技与清华大学联合开发的AI视频生成工具,旨在通过人工智能技术将文本和图像转化为高质量的视频内容。

作为中国首个长时长、高一致性、高动态性的视频大模型,Vidu 在视频生成领域具有显著的技术优势和创新性。

猛一看,来头不小,有没有这么厉害呢?

强大的语义理解

语义理解这个东西,我们普通人其实很难建立一个评判标准,但就我的体验而言,Vidu的语义理解的确不一样。

比如我已经有了一个人物的三维视角图片,想要生成一个动态视频。

我的提示词是:

小女孩在玩具城里行走,快速转身到背面,左顾右盼,镜头轻微向右移动

有发现结果了什么不同吗?

对比这三个视频生成工具,可以看到Vidu做到了以下几点:

- 识别出图片人物是一个人的不同视角

- 理解用户给出一个人的不同视角,是为了更好的视频呈现,而不是真的想画三个人

- 背景调整,根据要求变成“玩具城”

说到这里,可能有人会diss一下,“你这提示词不行啊”。

没错,提示词的不同,可能会产生10分和70分的差距。

可这样一来,想做高质量的视频,还需要先成为一个提示词专家吗?

显然在Vidu这里,大可不必。

一致性,一致性,一致性

我在上一篇写海螺AI的文章中,提到它解决了动态一致性的问题,即人脸在快速的运动中能够保持清晰。

在这一点上,Vidu同样优秀。

而他们新出的Vidu 2.0模型,还能做到更多。

比如

多主体参考

可以同时参考多个角色:

也可以将不同主体融合,比如给出人的正脸和另一个人的背面,Vidu可以生成一个新的人物。

对象和场景参考

它还支持人物以外的对象参考,以及环境背景参考,保持所有元素的一致性。

高动态性

这个词可能很难理解,不过从我的体验中,大概能做一些总结。

我想要生成一个在沙滩跳舞的视频。

对比结果,我称它为断头杀。

因为人的身体和头如果可以这样转,那他已经是个死人。

同样的提示词,Vidu给我的是这样:

知道了吧,Vidu的视频有以下几个特点:

- 动作幅度大、速度快

- 动态中保持自然流畅

- 符合人体运动规律

质量上面的差距,很明显了。

又快又便宜

在制作耗时上,Vidu比即梦和海螺都要快,这一点可以说是一个很大的惊喜。

价格方面,Vidu每秒最低4分钱,720P视频每秒成本0.258元,是行业平均价格的43%。

加上它推出的错峰模式,闲时不限量生成,不卡积分、不卡条数。

性价比拉满。

对了,它还有批量功能,一次最多可以生成4个视频。

太适合预算有限,又需要大量素材的人群了。

反思

在使用中,我也发现了一点小瑕疵,比如:

- 清晰度没有海螺AI高,像沙滩上跳舞就是个例子,当然这可能是另外的价钱

- 符合人体运动规律这点,有时候会翻车,不过和其他AI视频工具相比,概率小很多

- 严格参考主体,衣着可能不符合场景,当然Vidu提供了框选功能,能够一定程度上避免这个问题

总体上还是瑕不掩瑜的。

而AI图片、AI视频工具这么多,我们要做的,就是了解不同的工具特性,按照自己需求,使用最合适的工具。

我是阿宁,你懂的越多,你不懂的越多,我们下次见。

出处:微信公众号 @阿宁聊AI